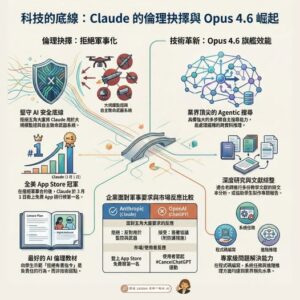

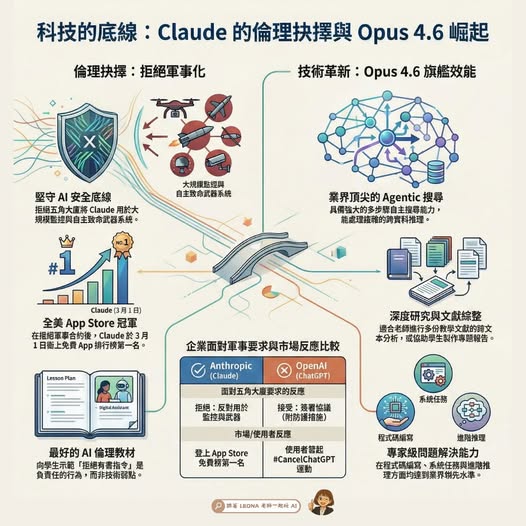

這週最讓人震驚的 AI 新聞,不是哪個模型跑分最高

而是一家 AI 公司因為「拒絕幫軍隊做武器」,反而衝上了全美 App Store 第一名。

這家公司,是 Claude 的開發商 Anthropic。

▍事情是這樣發生的

2 月底,美國五角大廈(國防部)要求 Anthropic 鬆綁 Claude 的安全限制,允許軍事用途。

Anthropic 的回應是:拒絕。

理由很清楚:Claude 不應被用於大規模監控與自主致命武器系統。

結果?五角大廈取消合約,把 Anthropic 列為「激進左派 AI 公司」。

反觀 OpenAI,隨即宣布自己簽了五角大廈協議(附上「有防護措施」),但大批 ChatGPT 用戶開始喊出 #CancelChatGPT,轉向 Claude。

3 月 1 日,Claude 登上美國 App Store 免費 App 排行榜第一名。

▍為什麼老師要在意這件事?

我們每天在課堂上使用 AI 工具,也引導學生使用。

選擇一個「願意為了安全底線說不」的 AI,不只是工具選擇,更是一種示範:

• 示範給學生看:科技公司可以有立場與原則

• 示範「拒絕有害指令」不是弱點,是負責任的行為

• 示範 AI 倫理不是課本裡的名詞,而是真實發生的事

這件事,本身就是一堂絕佳的資訊素養與 AI 倫理課!

▍同步登場:Claude Opus 4.6 旗艦模型

就在這場風波之中,Anthropic 悄悄發布了最新旗艦模型 Claude Opus 4.6。

官方公告的四大亮點:

• 真實工作任務表現業界頂尖(比較各專業領域的實際使用情境)

• 多步驟 Agentic 搜尋能力最強:能自主執行複雜的跨資料搜尋與推理

• 程式碼與系統任務能力出色

• 進階推理延伸至專家級問題

安全測試同樣通過:整體安全評分在業界所有前沿模型中位居前列。

▍教學現場可以怎麼用?

情境一:帶學生討論 AI 倫理

把這週的新聞印出來,請學生思考:

1. Anthropic 的決定對嗎?為什麼?

2. 如果你是 CEO,你會怎麼做?

3. 這件事對你「選擇使用哪個 AI」有影響嗎?

一個真實的新聞事件,帶出批判思考、AI 倫理、企業社會責任三個面向,比教科書還有說服力。

情境二:用 Opus 4.6 做深度研究任務

Opus 4.6 的多步驟 Agentic 搜尋特別適合:

• 老師:上傳多份教學研究文獻,請 Claude 進行跨文本綜整分析

• 學生:製作專題報告時,讓 Claude 協助搜尋、整理、推理,再由學生判讀驗證

重點是:學生不能只「接收答案」,要能說出「你怎麼判斷這個答案可信?」

情境三:引導學生認識 AI 的「開發者立場」

• 不同的 AI 工具,背後有不同的公司價值觀

• 帶學生查一查:GPT、Gemini、Claude 的公司分別是誰?它們的 AI 使用政策有什麼不同?

• 這就是現代公民素養的一部分

▍今天可以立刻試的第一步

1. 前往 claude.ai,免費帳號即可登入

2. 試試看:把一篇新聞貼進去,問 Claude「這件事有哪些不同的立場?」

3. 觀察它怎麼回答,感受一下和你習慣的 AI 有什麼不同

4. 如果你是付費用戶,可以在模型選擇中指定使用 Claude Opus 4.6

這週,最有教育意義的 AI 新聞不是某個功能更新,而是一家公司用行動證明:AI 可以有底線,也應該有底線。

你會把這個新聞拿來跟學生討論嗎?或者,這讓你重新思考自己使用的 AI 工具了嗎?留言告訴我!

歡迎點讚  、追蹤

、追蹤  和分享喔

和分享喔