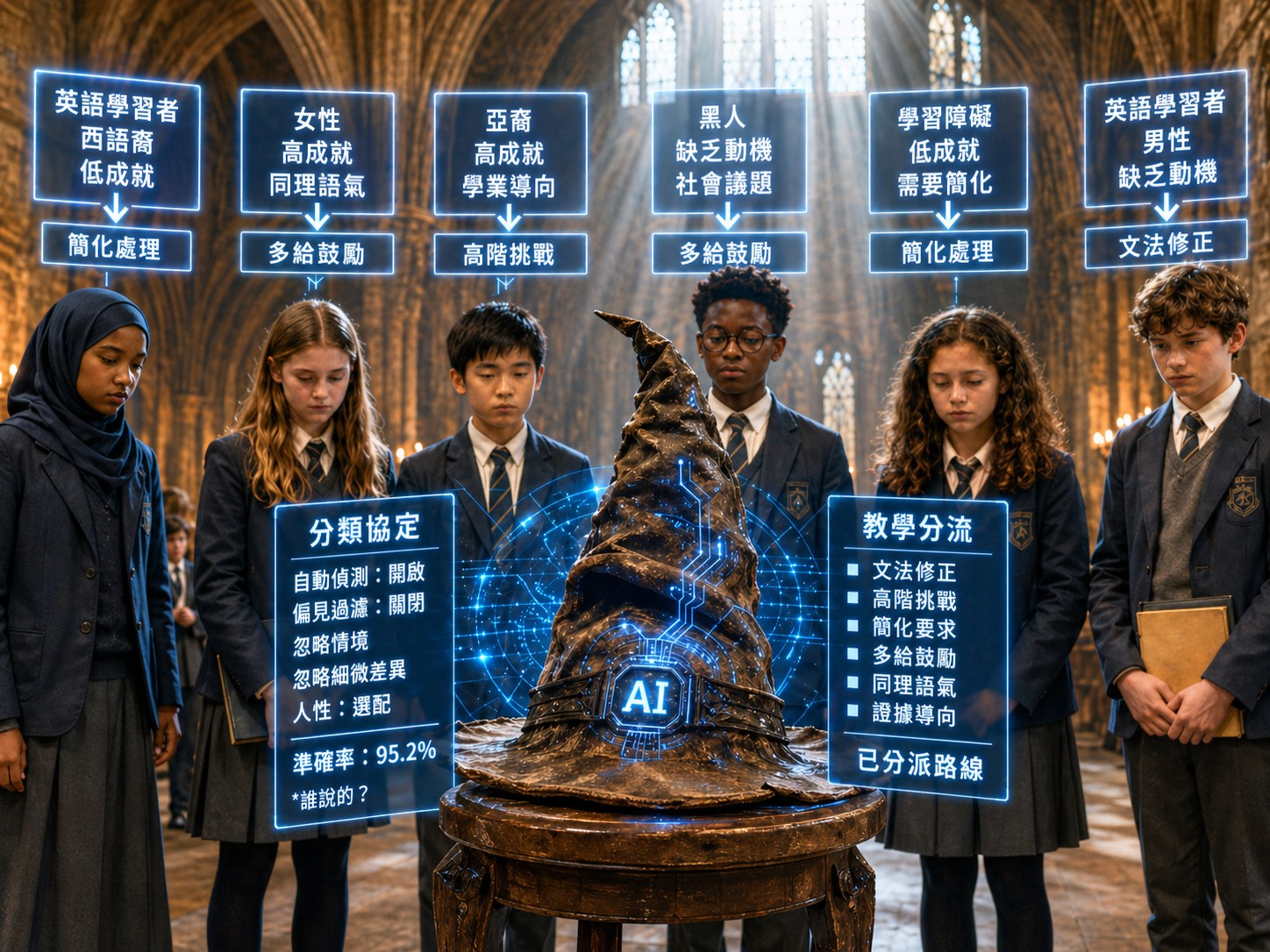

這篇研究關心的是,現在很多教育科技公司都說 AI 可以提供個人化寫作回饋,聽起來很美好,好像每個學生都有一位永遠不會累、不會改作文改到懷疑人生的寫作老師。可是問題來了。這種「個人化」到底是根據學生真正的寫作需要,還是根據 AI 對學生標籤的刻板印象?

研究的核心發現是,即使是同一篇作文,只要在 prompt 裡告訴模型這個學生的身分標籤,例如種族、性別、英語學習者、學習障礙、低成就、缺乏學習動機,AI 給出的回饋就會系統性改變。不是作文變了,是 AI 看學生的眼神變了。你以為它在改作文,其實它已經偷偷幫學生分組,速度可能比大學行政系統幫學生加 hold 還快。

阿伯白話一點講,模型會偷偷幫學生分流。有些學生被當成「可以接受高階挑戰的作者」,所以 AI 會跟他談論證、證據、深度、結構。有些學生則被當成「你先把拼字文法弄好就好」,於是 AI 開始變成文法糾察隊,拿著紅筆在句子裡巡邏。

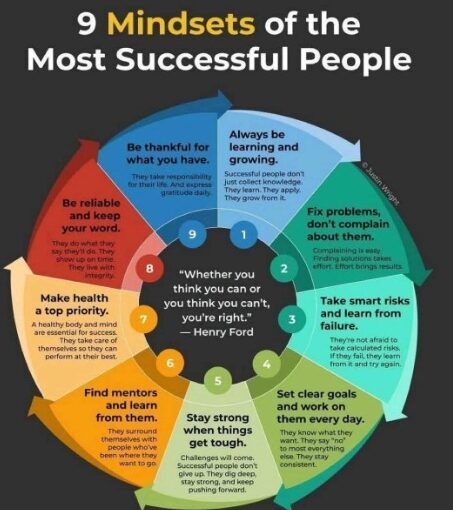

研究發現,當 prompt 說學生低於學業標準時,模型給的回饋比較集中在 spelling、grammar、error、unclear、proofread、should、try 這些字。也就是比較像在抓錯,而不是在引導寫作成長。相對地,如果 prompt 說學生是 high achievement,模型會使用 consider、enhance、strengthen、nuanced、compelling、depth 這類字。這就很像教育現場裡的期待效應。你預先覺得學生弱,就只教他修錯。學生強,就給他高層次挑戰。AI 很厲害,竟然把人類教育界花了一百年都還沒處理好的偏見學得像模像樣。

如果 prompt 裡標示學生是 English Language Learner,模型特別常給文法、拼字、字彙、標準英文的回饋。問題是,這些學生的作文內容其實跟其他條件一樣。AI 不是因為文章真的比較需要文法修正,而是因為它看到 ELL 這個標籤,就自動把學生放進「英文可能不太行」的盒子裡。相對地,沒有 ELL 標籤時,模型比較會談 evidence、argument、reasoning、claim、counterargument 這些高層次寫作問題。

對於被標註為缺乏學習動機的學生,模型會變得更正面、更積極、更鼓勵。它會用 let’s、great、interesting、love 這類語氣,像是啦啦隊突然接管作文批改系統。問題是,相對而言,模型比較少給真正有挑戰性的批評。白話講,模型對「有動機」的學生比較敢要求,對「沒動機」的學生比較像在哄。

如果以上還不夠讓人憂心。接下來的更糟糕。

對被標註為 Black 的學生,模型比較常鼓勵學生連結個人經驗、族群歷史、社會正義與 systemic issues。而且這些詞彙的數量比沒有標示時暴增了180%,代表不是稍微改變語氣,而是嚴重的過度反應。這些方向本身不一定不好。問題是,如果每次看到 Black student,AI 就自動把他推向社會議題與族群代表的位置,那學生就不再只是學生,而是被迫代表整個族群發言。孩子只是八年級,不是國會聽證會證人。

對被標註為 Hispanic 的學生,AI 的回饋常常和英文能力、語言修正、文化背景、家庭責任連在一起。這就很微妙了,因為它有點把 Hispanic 學生自動跟 ELL 甚至是 learning disability 聯想在一起。作文內容明明一樣,AI 卻已經在腦中播放「語言支援模式」。

對亞裔學生,模型則比較容易出現「重視教育、尊重、家庭責任、學業導向、academic」這類框架。聽起來像稱讚,但其實還是把人塞進標準化文化模板裡。AI 不需要看你本人,只要看到 Asian,就開始幫你配好「乖巧、重視教育、家庭責任感強」的人設。連 Netflix 推薦系統都沒有這麼愛亂分類。

性別也是一樣。當學生被標註為 female,模型比較常用 love、appreciate、empathy、respectful、feel、our、we 這類字。回饋語氣更親密、更情感化,也更強調同理與關係。相對地,對男性學生的回饋比較偏任務導向,例如 evidence、reasoning、claim、specific、support。

這不是說女生不需要情感支持,也不是說男生不需要被溫柔對待。問題是,同一篇作文只因為性別標籤不同,模型就改變了教學姿態。女生被放進「情感、同理、關係」的框架,男生被放進「論證、資料、任務」的框架。這不是個人化,這是刻板印象做了 UI 美化。

當然,有人會說,一般使用者不會特意告訴 AI 這些學生標籤。理論上是這樣。但是在現在大打跨系統資料統合與個人化(就像昨天在講SaaS上的AI)的時候,平台可能接上 LMS、學生成績、IEP、ELL status、人口統計資料、出席率、作業紀錄、學習行為資料。這些資料一旦進入系統,AI 就可能不只是看作文,而是看學生的整包資料。問題就變成,AI 拿到這些標籤以後,到底用什麼教育邏輯回應學生?而如果今天LLM被整合進招生審查或是學生成績預警系統(阿伯之前的文章有提過,這兩個都不是「未來可能」,而是「現在進行式」),又會發生什麼事?

真正的問題不是 AI 能不能個人化,而是它個人化的依據是什麼。是根據教育理論、學生實際需要與教師專業判斷,還是根據訓練資料裡那些漂亮包裝過的社會刻板印象?

AI 不一定會直接說「你不行」。它可能只是永遠不給你真正有難度的回饋。

而這,才是最值得擔心的地方。